As máquinas estão ficando cada vez mais inteligentes. Se antes os robôs eram criados para fazer as tarefas manuais, poupando o esforço mecânico dos humanos, hoje eles já são equipados com inteligência artificial, capazes de identificar padrões para realizar tarefas que exigem certo intelecto.

O problema se dá quando esse padrão identifica e reproduz atitudes preconceituosas e discriminatórias que estão enraizadas na sociedade e que, muitas vezes, não são percebidas pelas pessoas, por isso, continuam sendo praticadas inconscientemente.

Christian Geronasso, consultor de transformação digital na SAP, empresa alemã associada à VDI-Brasil, escreveu um artigo tratando sobre o viés discriminatório reproduzido por equipamentos que estão presentes em grandes empresas ao redor do mundo. Confira abaixo o texto na íntegra.

Inteligência Artificial, o caminho para um novo Arpartheid

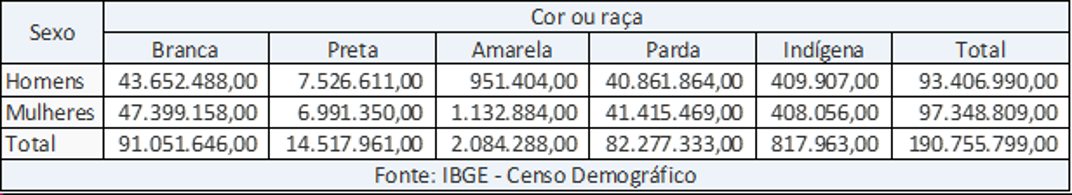

De acordo com dados do último Censo, realizado em 2010, 99.6 milhões de brasileiros são classificados pela cor/raça: preta, amarela, parda ou indígena. Minoritariamente, representando 48% da população, estão os 91 milhões de brasileiros considerados brancos. E esse percentual reduz com o passar dos anos. Segundo a Pesquisa Nacional por Amostra de Domicílios Contínua (Pnad Contínua), realizada em 2016, o contingente de cor branca representava 44,2 %. Já o percentual de habitantes mulheres permaneceu igual entre 2010 e 2016, representando 51% da população total.

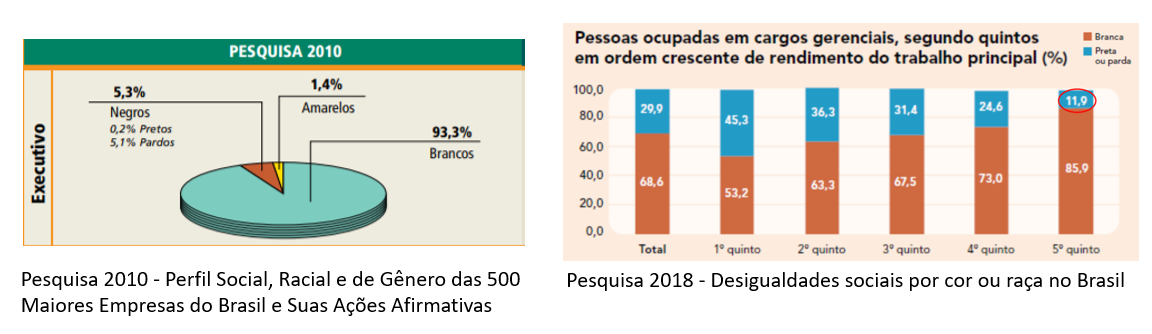

Como vemos neste levantamento, homens brancos são a minoria. Agora, pare por um minuto e analise o seu local de trabalho. Volte ao passado, lembre-se das empresas em que já trabalhou. Essa minoria se apresenta como maioria dominante no mercado de trabalho. Mesmo em empresas que possuem maior diversidade, poucas pessoas que não se enquadram nessas características alcançam os cargos de gestão das empresas.

Mesmo em meio a esta realidade, é possível enxergar um caminho para um país com menos desigualdade por cor ou raça. Em novembro do ano passado, foi divulgado pelo Instituto Brasileiro de Geografia e Estatística (IBGE) o relatório ‘Desigualdades sociais por cor ou raça no Brasil’. Segundo o documento, em 2018, a população preta ou parda passou a representar 50,3% dos estudantes na rede pública de ensino superior. Consequentemente, com mais acesso à educação, as oportunidades aos cargos gerenciais de alta renda, que hoje são predominantemente ocupados por brancos (85,9%), tendem a crescer para essa parcela da população.

No entanto, mesmo com os avanços obtidos, não podemos ignorar o passado. Dados históricos são o combustível para os algoritmos ‘inteligentes’ identificar padrões para tomar futuras decisões. Vamos imaginar uma situação hipotética, em que uma pessoa está responsável por decidir qual o melhor candidato para assumir a posição de executivo em determinada empresa. Para tomar a melhor decisão, o recrutador recorre à fórmulas estatísticas, que mostram características em comum dos executivos de sucesso no Brasil dos últimos 10 anos. Em 2010, apenas 5,3% dos cargos executivos eram ocupados por negros. Em 2018, esse número subiu para 11,9%. Com base nessas informações, os dados passarão a excluir os grupos menos representativos, que neste caso não correspondem aos homens brancos. Em empresas que estimulam a diversidade e o pensamento inclusivo este tipo de decisão será tomada com ponderações que, obrigatoriamente, analisarão outros critérios.

O problema acontece quando a Inteligência Artificial automatiza a tomada de decisão, explorando dados históricos que, se analisados de forma fria, resultam em conclusões que consistem na ideia de que negros e amarelos têm menos chance de sucesso em um cargo executivo, pois correspondem a uma porção menos representativa desses dados.

O problema acontece quando a Inteligência Artificial automatiza a tomada de decisão, explorando dados históricos que, se analisados de forma fria, resultam em conclusões que consistem na ideia de que negros e amarelos têm menos chance de sucesso em um cargo executivo, pois correspondem a uma porção menos representativa desses dados.

Esses algoritmos inteligentes resultam da prática de Aprendizado de Máquina (Machine Learning), conceito que floresceu na década de 1990 com a revolução dos computadores pessoais, utilizando principalmente fórmulas estatísticas de previsão. Machine Learning é uma técnica para treinar modelos e replicar padrões de sucesso, por meio da análise de grandes volumes de dados. Tais modelos são utilizados em decisões futuras.

Apesar do conceito de Inteligência Artificial, e suas derivações, existirem desde 1956, a tecnologia disponível naquele momento não permitia sua utilização em larga escala. Com o tempo, a limitação tecnológica foi ficando cada vez menor. Atualmente, essa limitação está na capacidade dos desenvolvedores de encontrar novas formas de aplicação.

Diariamente, diversas decisões do seu cotidiano são tomadas por algoritmos inteligentes. Ações como o caminho que você segue em seu aplicativo favorito para ir ao trabalho, a liberação do empréstimo pessoal com base no modelo de melhores pagadores, e até qual o próximo vídeo que o Youtube irá recomendar com base no que você já assistiu.

Muito longe de um Apartheid – homologação governamental, legislativa, da discriminação, na África do Sul em 1948 -, os modelos preditivos de Machine Learning que tomam decisões separatistas existem por desinformação dos desenvolvedores e das empresas. Veja alguns exemplos de consequências da falta de diversidade no treinamento destes algoritmos:

FaceApp, o Algoritmo discriminatório de embelezamento

Em 2017, o aplicativo FaceApp fazia sucesso entre os usuários das redes sociais. A partir de uma imagem com um rosto era possível aplicar vários filtros que previam como a pessoa seria quando atingisse uma idade avançada ou se fosse do sexo oposto. Além disso, também era possível aplicar um filtro ‘embelezador’. A polêmica surgiu quando negros utilizavam o filtro da beleza e percebiam que o seu tom de pele ficava mais claro nas imagens após a aplicação do filtro. Acontece que, para treinar o algoritmo foram utilizadas milhares de imagens contendo apenas pessoas brancas, o que o levava a forçar o clareamento da pele das pessoas, baseado em sua amostra.

Identificação de doenças através de algoritmos

Identificação de doenças através de algoritmos

A cada dia que passa mais instituições utilizam algoritmos para auxiliar no diagnóstico e tratamento de doenças. Angela Benton, CEO da Streamlytics, alerta que, apesar de 40% da população norte-americana ser negra, a porcentagem dos participantes de outras raças nos testes clínicos corresponde apenas a cerca de 10% a 20% do total. Em 2015, apenas 1,9% dos estudos sobre doenças respiratórias incluíam algum tipo de minoria. Angela foi diagnosticada com câncer de mama aos 34 anos, e relata que foi extremamente difícil obter a aprovação para realizar a mamografia, mesmo sendo comprovado que mulheres negras são diagnosticadas com câncer de mama mais jovens que mulheres brancas. Resultado de uma amostra de dados enviesada.

Apple Card, o cartão de crédito tendencioso

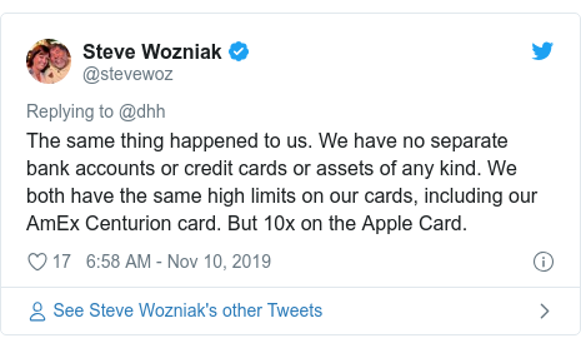

Em agosto de 2019, a Apple passou a oferecer a seus clientes o Apple Card, um cartão de crédito desenhado para consumidores atingirem uma vida financeira mais saudável. Em novembro do mesmo ano, David, casado com Jamie Heinemeier Hansson, compartilhou em sua conta do Twitter que apesar de sua esposa ter um melhor score de crédito, de possuírem partes iguais em suas propriedades e de declararem seus impostos de forma conjunta, ele possuía 20 vezes mais crédito para empréstimo que a sua esposa. Nem mesmo Steve Wozniak, co-fundador da Apple escapou. Wozniak e sua esposa compartilham tudo, desde sua conta bancária até seus ativos, mas, ainda assim, o crédito em seu Apple Card era 10 vezes superior ao dela.

Algoritmos da Amazon preferem homens em processo seletivo

De acordo com uma matéria publicada pela Reuters em outubro de 2019, a Amazon utilizou algoritmos de inteligência artificial para automatizar a seleção dos melhores currículos para as vagas disponíveis, entre 2014 e 2015. Esse é um custo operacional considerável para o departamento de Recursos Humanos. O site Catho, por exemplo, oferece o serviço de análise de currículos ao valor de R$ 69,00. Esse é um serviço que analisa e sugere modificações para aumentar as chances do candidato de ser escolhido. Suponhamos que um recrutador consuma 30% deste valor para analisar e classificar um currículo, portanto R$ 20,00 por currículo. Para uma vaga com 500 interessados, o custo seria de R$ 10 mil apenas para filtragem dos currículos.

Nesse sentido, reduzir o custo com automatizações é uma grande oportunidade. Ao identificar essa possibilidade a Amazon treinou algoritmos com os 10 anos anteriores de contratações bem-sucedidas. O algoritmo aprendeu que homens deveriam ser a preferência e passaram a excluir currículos que continham, por exemplo, “Mulher” ou “Clube de Xadrez Feminino”.

Algoritmos que decidem nosso futuro, e nos ajudam a tomar as supostas melhores decisões, são codificados por especialistas da computação. Ou seja, em sua essência, são pessoas que retratam em seus códigos o padrão a que foram expostos ao longo de suas vidas.

Pessoas que estão fora dessa maioria representada não possuem um devido espaço de fala para criticar esses modelos, por isso, o preconceito passa despercebido para uma parcela da população.

Por isso, cabe às empresas estipularem metas mais claras de diversidade, evitando que novos casos de segregação e descriminação algorítmica aconteçam. Existem milhares de casos como os exemplos citados. Algoritmos que, neste momento, estão definindo qual o melhor desconto para você, quais amigos você deveria adicionar em suas redes sociais, quais vídeos ou músicas você deveria apreciar, podem estar atuando como catalizadores separatistas.

Comunicação e conscientização integram a primeira frente de defesa para evitar a proliferação destes modelos tendenciosos. Empresas mais maduras, como a alemã SAP, definem conselhos com metas claras para que a inteligência artificial promova um mundo mais igualitário. Cabe a cada um de nós assumir um papel para evitar a continuidade desta economia da discriminação.

Autor:

SAP Digital Transformation Advisor